この記事について

Cursorでは色々なLLMを使用できますが、いずれも無料プランだと使えるトークン数に制限があることがほとんどです。ローカルLLMを使えれば無料で使い放題になるのでは、ということで設定してみました。

Ollamaの起動確認

Ollama(オラマ)は、MacやWindowsなどのローカル環境でLLMを動かすための、オープンソースツールです。公式サイト (ollama.com) インストールは、当サイトの2026年2月版:Mac開発環境セットアップで行っています。

サーバーとクライアントで2つターミナルを起動してそれぞれ入力します。

サーバー側起動

ollama serveクライアント側起動

ollama run llama3.1LlamaはMeta社が開発した、ローカルでの実行に向いたLLMです。現在はバージョン4まであるようですが、Geminiが提案してきたまま少し前の3.1を起動。初回はモデルのダウンロードに時間がかかりますが、終了するとクライアント側にLLMへのプロンプトを入力できるようになります。

>>> こんにちは

こんにちは。どうですか?

>>> ぼちぼちでんな

楽しそうにしていないようだね。なにかいい事や面白いことを見つけた?Cursorでのモデル設定追加

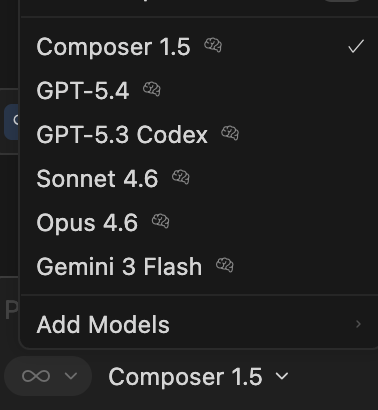

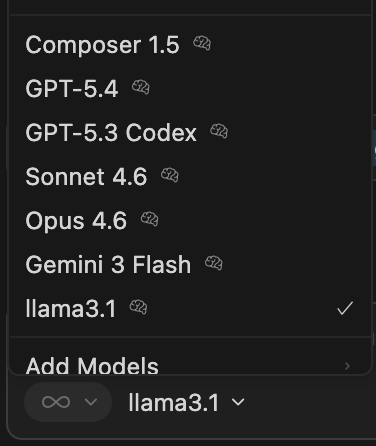

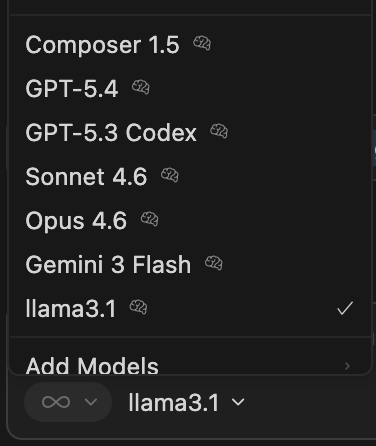

現状、選択できるモデルは下記の通りです。

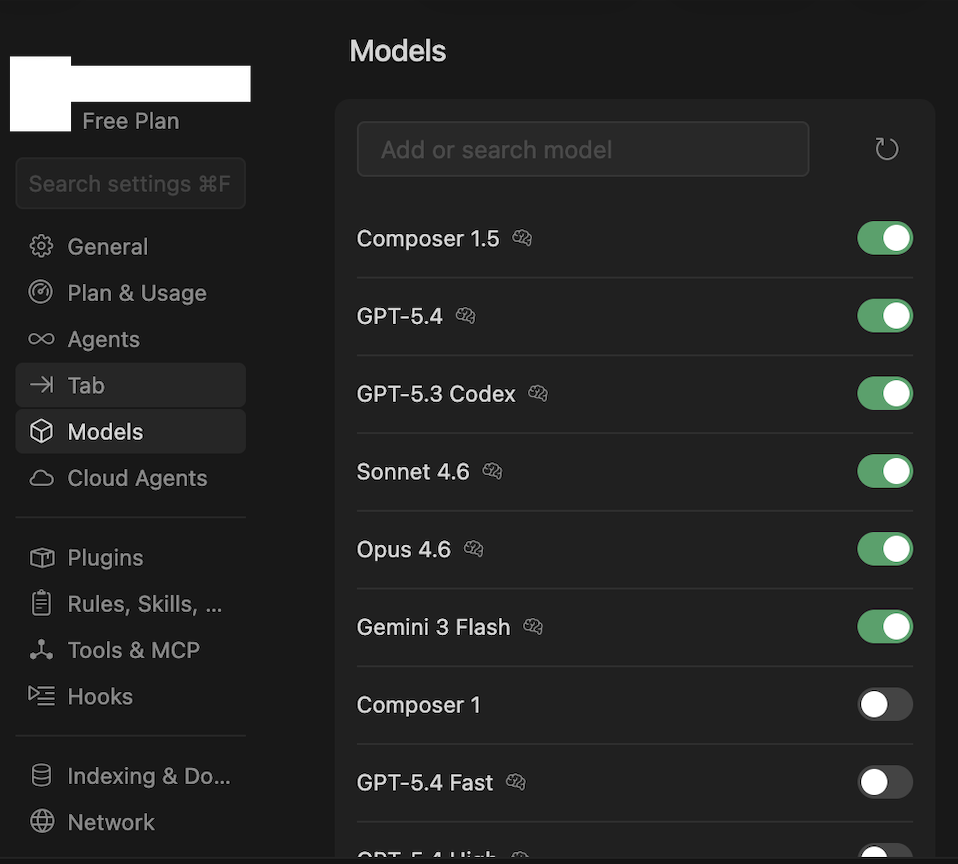

リストの一番下にある「Add Models」をクリックすると設定ページが開きます。

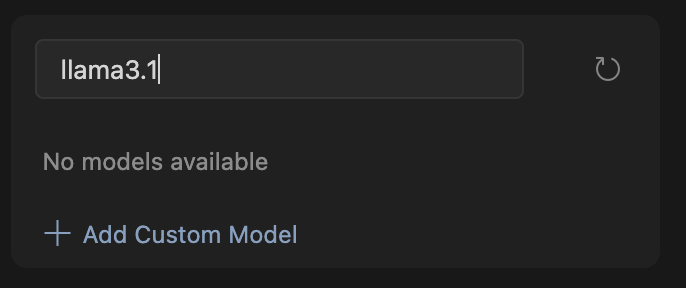

llama3.1を探しますが、見つかりません。

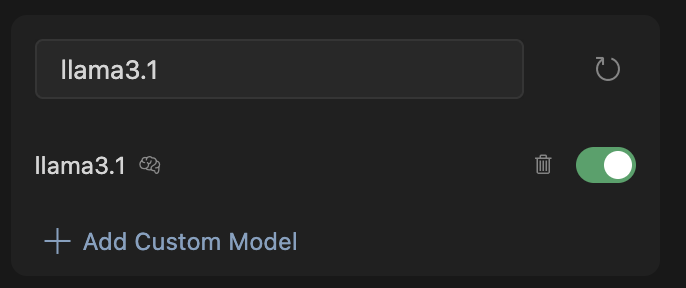

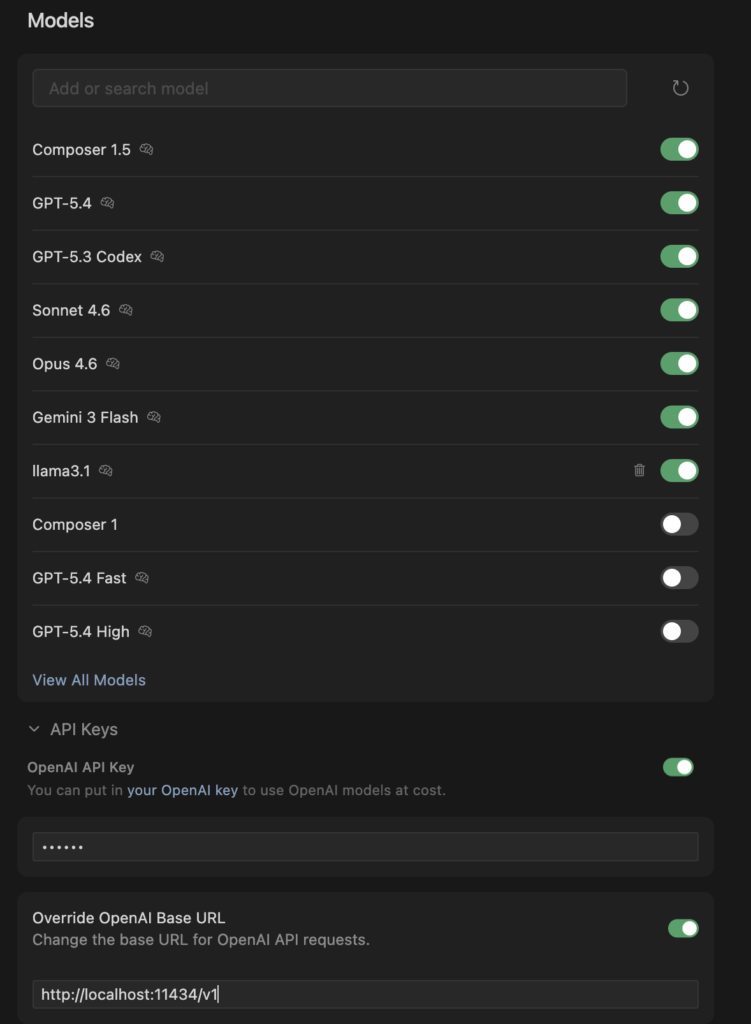

Add Custom Modelでllama3.1を追加して、ONになっていることを確認します。

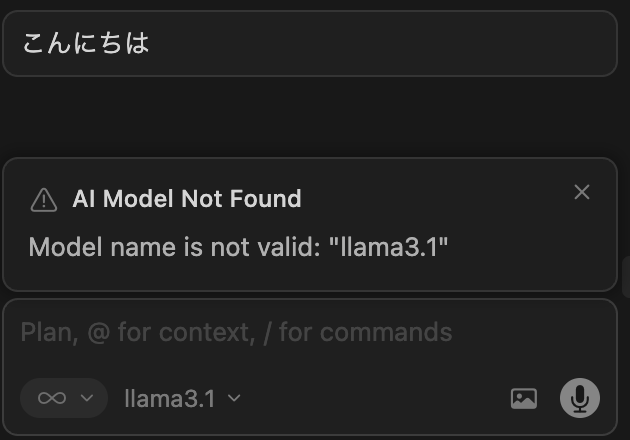

これで、Cursorのチャットパネルでllama3.1を選べるようになりました。

でもこれだけだとエラーが出てチャットできません。

OllamaはOpenAIの通信形式(API)と互換性があるため、OpenAIの設定欄を利用します。

Cursor画面右上の歯車アイコンで設定ページが開くので、Modelsを選択します。

API Keysの中にある、「OpenAI API Key」を有効にして、値は適当に「ollama」などを入力しておきます。実際にOpenAI API Keyを使用する場合は併用できなさそうです。その下にある、「Override OpenAI Base URL」も有効にして、「http://localhost:11434/v1」と入力します。これでCursorからllamaに話しかけますが、ダメなようです。

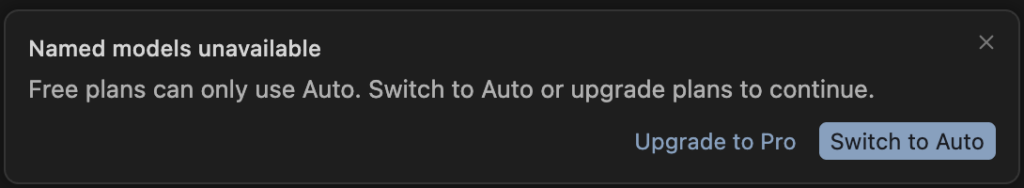

Geminiに報告したところ、無料プランではローカルLLMに接続できないという残念な結論に。本家 VS Code に 「Continue」 という拡張機能を入れるとできるようなので、別途トライしてみます。

コメント