きっかけ

CursorでローカルLLMを使用するためには、LLMの選択で「Auto」をオフにして個別にモデルを指定する必要がありますが、無料プランではできませんでした。(記事:CursorでローカルLLMを使えるようにしてみたけど無料プランではできなかった)Geminiによると、VS Code と Continue拡張機能を使えばローカルLLMでの環境を作れるとのことでしたので、チャレンジします。

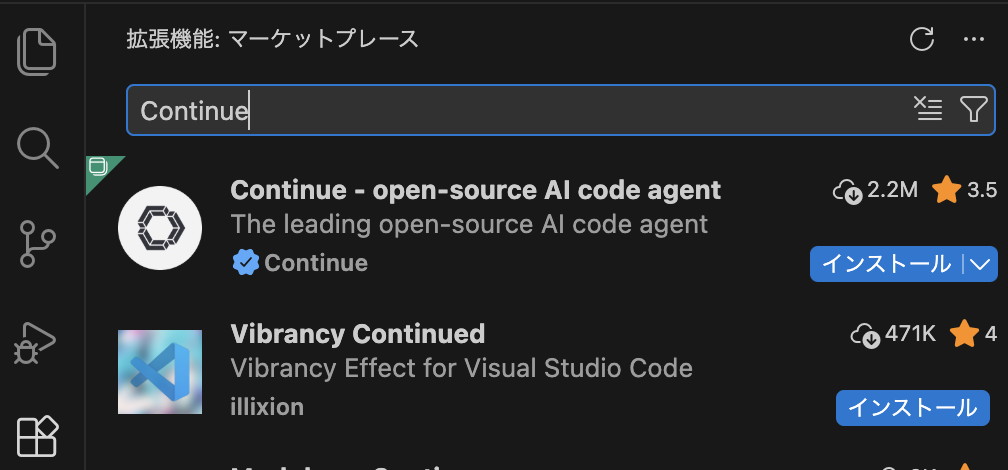

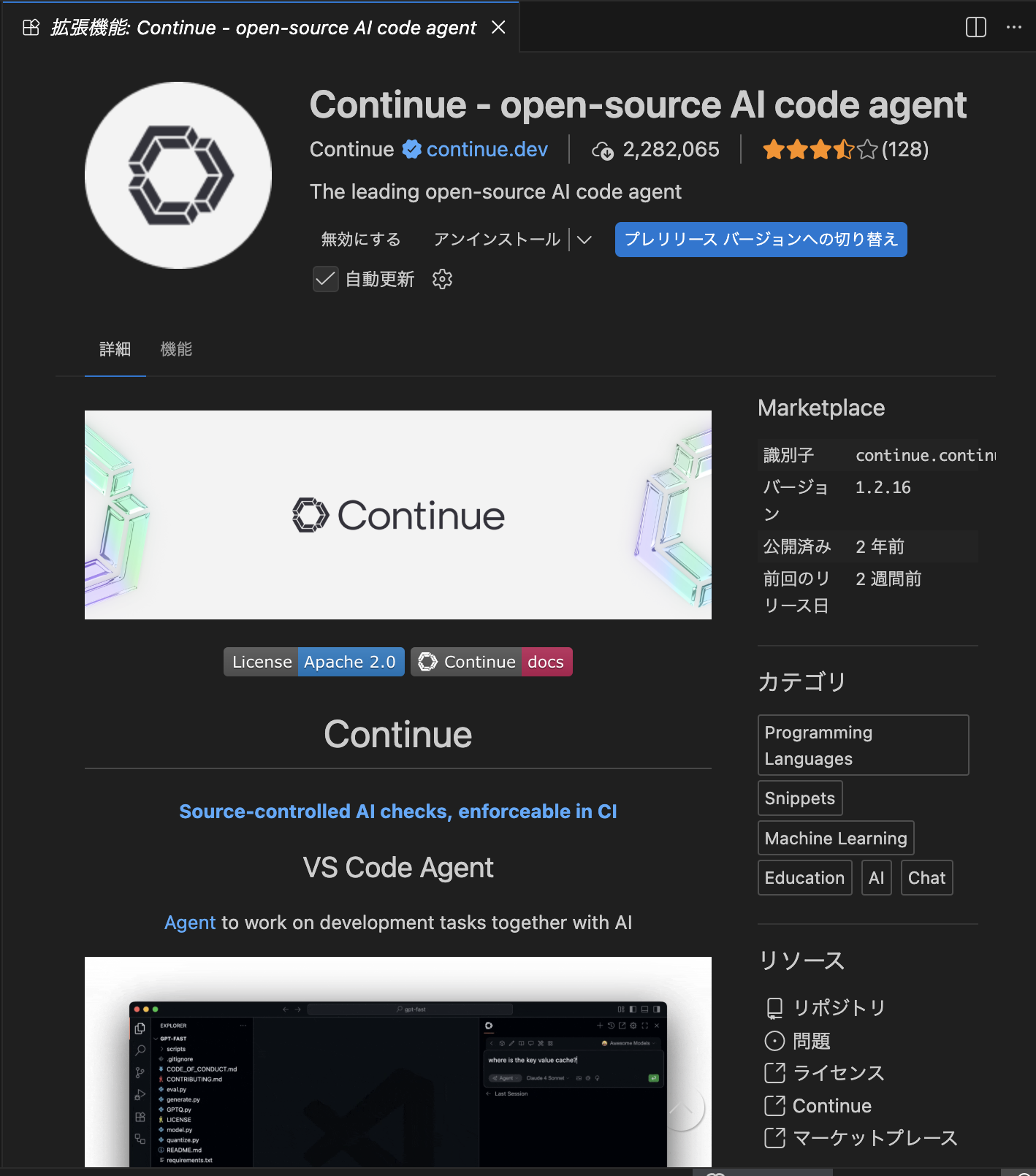

Continue拡張機能のインストール

VSCodeの拡張機能で、「Continue」 を検索してインストールします。

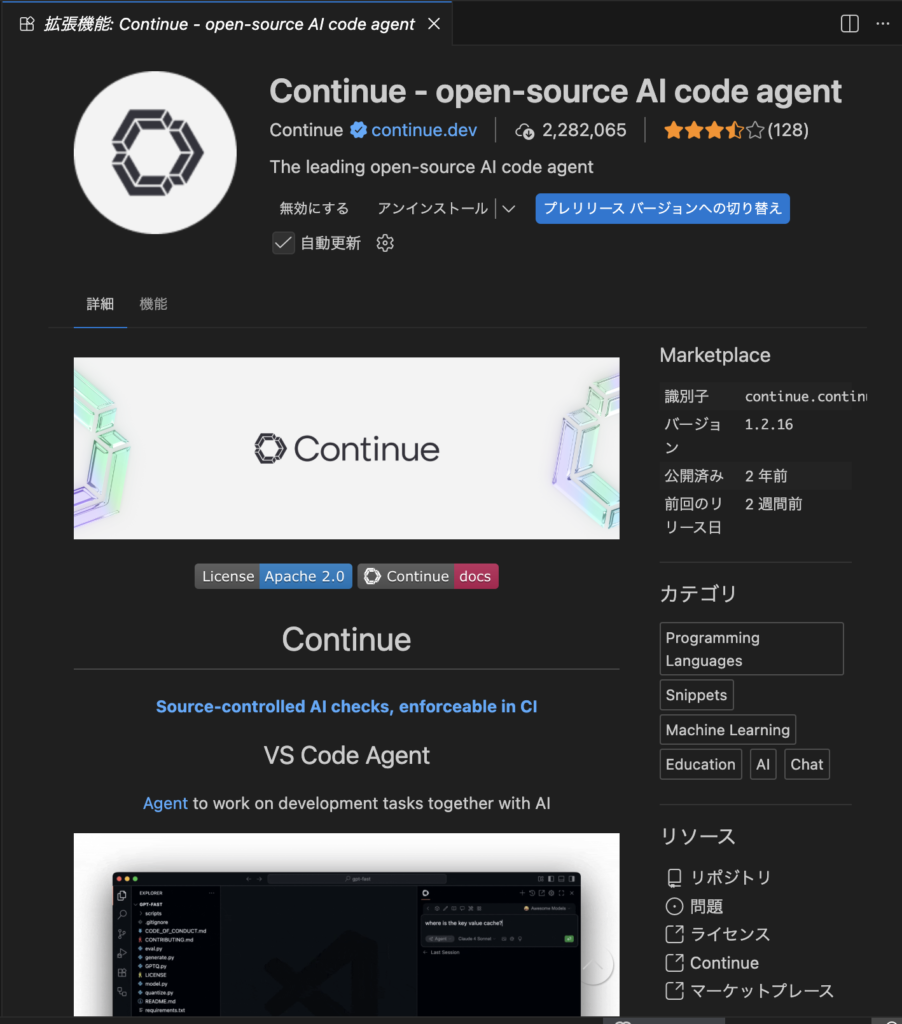

サイドバーに、Continueのアイコンが追加されました。

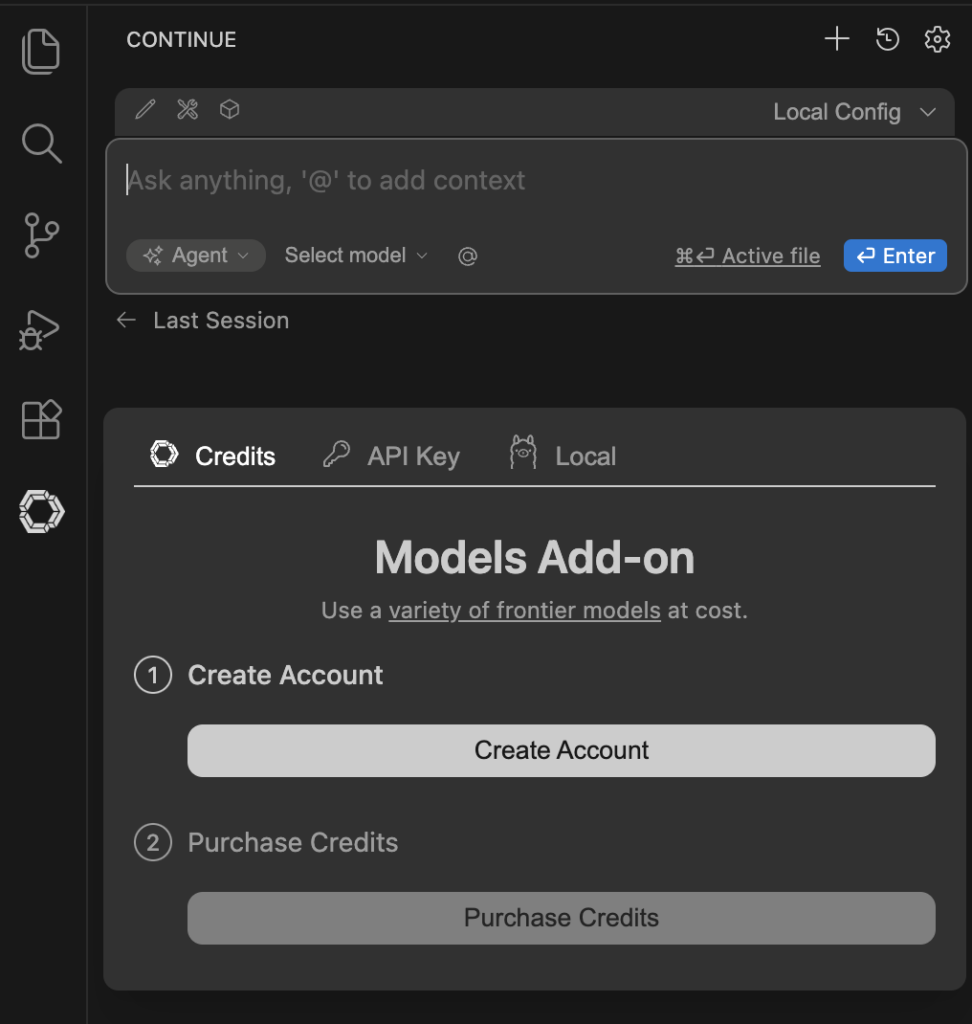

Ollama(Llama 3.1)の登録

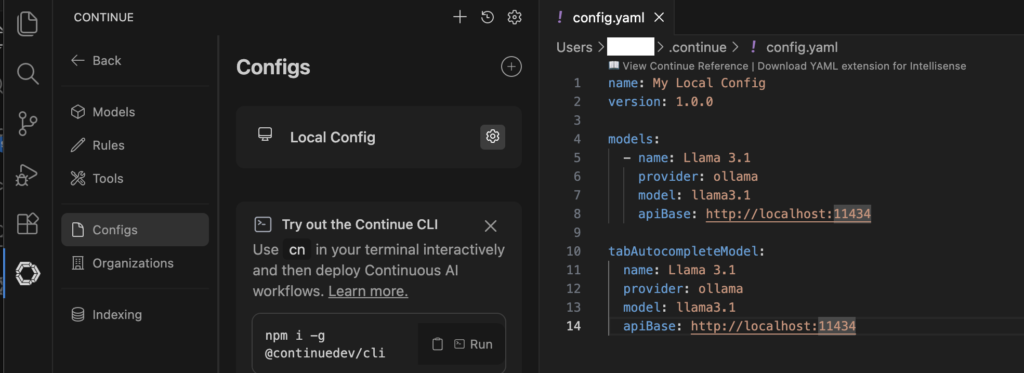

Continueタブの右上歯車アイコン→Configs→Local Configの歯車アイコンから、config.yamlの編集を行います。

config.yaml

name: My Local Config

version: 1.0.0

models:

- name: Llama 3.1

provider: ollama

model: llama3.1

apiBase: http://localhost:11434

tabAutocompleteModel:

name: Llama 3.1

provider: ollama

model: llama3.1

apiBase: http://localhost:11434Ollamaサーバー起動

ターミナルでローカルLLMのサーバー側を起動しておきます。

ollama serveLlama3.1に話しかける

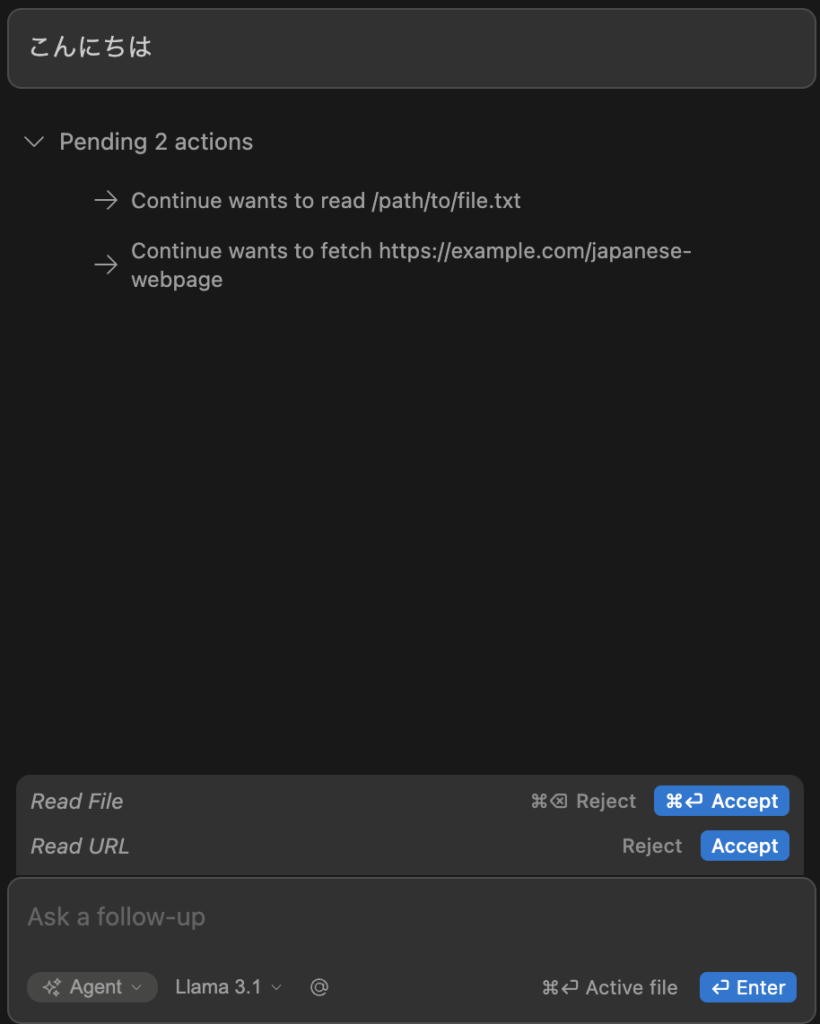

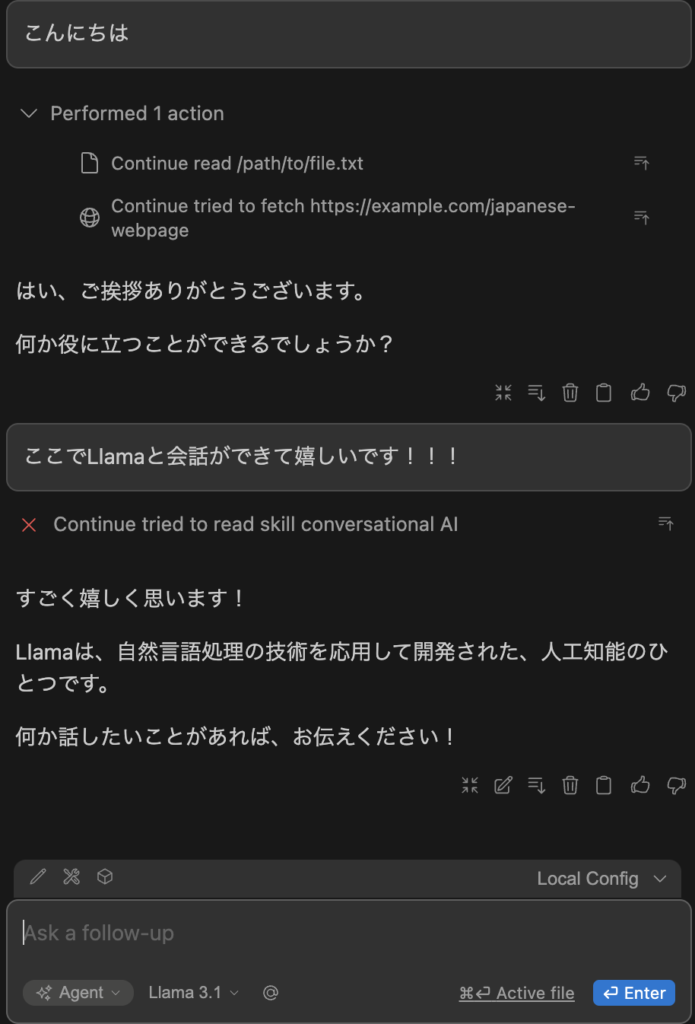

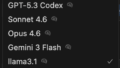

LLMでLlama3.1を選択できるようになり、チャットできそうなので話しかけてみます。

まだ何か足りないようです。

青いボタンのAcceptをクリックしたら先に進めました。その次にスキルの確認用のAcceptはエラーでしたが、とりあえずチャットはできるようになりました。

この環境で、今後いろいろ試してみたいと思います。

コメント